光達是 2008 年的拐杖:Tesla 為何堅持只用攝影機

雞過馬路的問題

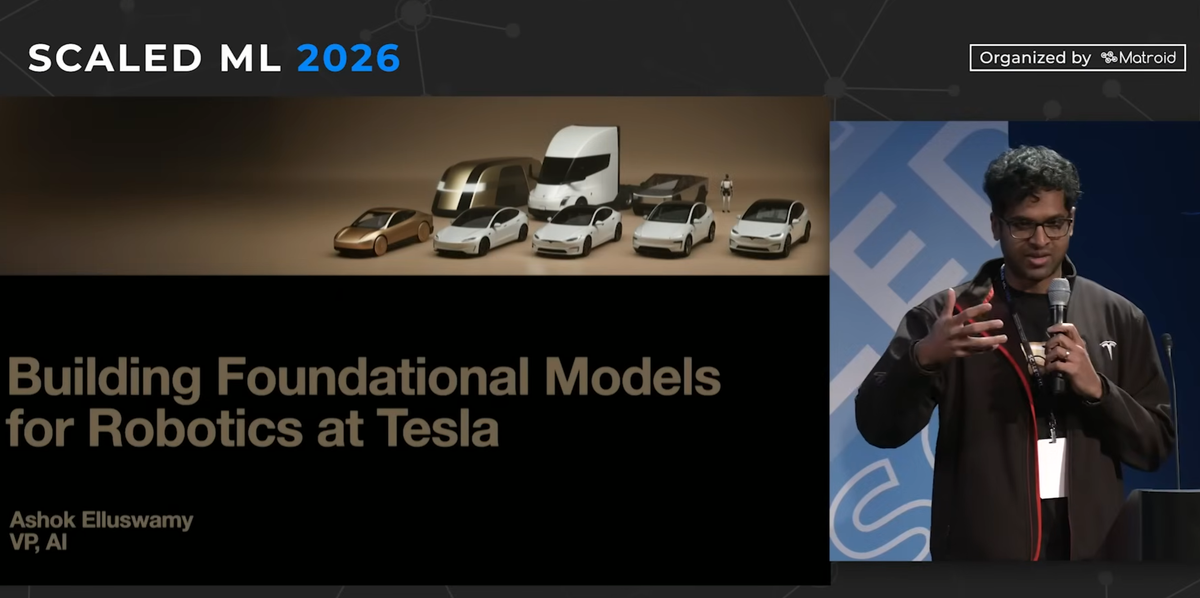

Tesla AI 副總裁 Ashok Elluswamy 在 2026 年 ScaledML 大會上發表演講,播放了一段 FSD(Full Self-Driving)的實際畫面:一群雞正在過馬路,車子耐心等待,連最後一隻落單的雞都沒漏掉,等牠們全部通過後才繼續前進。

這看起來是個可愛的小故事,但 Ashok 拋出的問題很尖銳:如果你用傳統方法寫自駕軟體,你要怎麼處理這個場景?先寫一個雞腿偵測器,然後預測雞的移動軌跡,再根據預測結果決定要不要煞車?

接著他播放另一段影片:一群鵝站在路中間,但牠們不打算過馬路,只是站著。車子判斷牠們不會移動,於是倒車繞過去。同樣的鳥類,不同的行為,系統做出不同的決策。Ashok 說,端到端神經網路可以從畫素直接學會這些細微差異,不需要工程師手寫規則。

這就是 Tesla 自駕技術的核心哲學:不寫規則,讓 AI 自己學。而這個選擇,正是 AI 領域最著名的經驗法則「Bitter Lesson」的實踐。

Bitter Lesson:70 年 AI 歷史的教訓

2019 年,強化學習先驅 Richard Sutton 寫了一篇短文叫「The Bitter Lesson」(苦澀的教訓)。他回顧 70 年的 AI 發展史,得出一個讓很多研究者不太舒服的結論:那些靠人類領域知識精心設計的系統,最終都會被靠運算規模取勝的方法打敗。

西洋棋是這樣,圍棋是這樣,語音辨識是這樣,電腦視覺也是這樣。每一次,研究者都以為自己找到了正確的「結構」或「先驗知識」,結果幾年後就被更大的模型、更多的數據、更強的算力碾壓過去。Sutton 說,這個教訓很苦澀,因為它意味著我們對問題的「理解」其實沒那麼重要,重要的是規模。

Tesla 的自駕團隊顯然讀過這篇文章。Ashok 在演講中明確說:「我們站在 Bitter Lesson 正確的那一邊。」他們押注的是神經網路規模、數據量、訓練算力,而不是手工設計的規則和模組。

Tesla 的選擇:端到端 vs 模組化

自駕產業的主流做法是模組化架構:把問題拆成感知(Perception)、預測(Prediction)、規劃(Planning)三個獨立模組。感知模組負責辨識車輛、行人、車道線;預測模組負責推算其他道路使用者的未來軌跡;規劃模組負責決定自車該怎麼走。這個架構很符合軟體工程的直覺,關注點分離,各司其職。

但 Ashok 認為這種做法有根本問題:模組之間的介面會「漏」(leaky abstractions)。感知模組輸出的是物件清單和座標,但原始影像中的不確定性、細微線索、情境脈絡,很難完整傳遞給下游模組。他舉了一個例子:前方有個水坑,你通常會想繞過去,但繞過去就要跨到對向車道。這時候你要考慮的不只是「有水坑」和「對向車道危險」這兩條規則,還要看對向有沒有來車、視線夠不夠遠、水坑有多深、路面有多寬。這些因素彼此糾纏,不是獨立規則能處理的。

Tesla 的做法是把整個系統變成一個端到端神經網路。輸入是 8 顆攝影機的原始影像、導航指令、車速、轉向角、音訊;輸出是下一個時間步的轉向角和加速度。沒有中間的物件清單,沒有明確的「這是車」「那是行人」的標註,所有資訊直接從畫素流向控制指令。

這個架構有幾個優勢。第一,資訊可以密集流動,不會在模組介面處被截斷。第二,延遲可控且確定,每 27 毫秒(36 Hz)輸出一次控制指令,不會因為場景複雜就變慢。第三,它符合 Bitter Lesson 的精神:與其花時間設計完美的中間表徵,不如讓神經網路自己學。

維度詛咒:20 億 tokens 變 2 個動作

但端到端也有代價,最大的挑戰是 Ashok 所說的「維度詛咒」(Curse of Dimensionality)。

Tesla 車上有 8 顆攝影機,每顆 5 百萬畫素,幀率很高。為了做出正確決策,系統需要記住過去 30 秒左右的歷史,例如誰先到停止線、前車剛才有沒有打方向燈。把這些資訊加總起來,Ashok 估算大約是 20 億 tokens 的輸入量。而輸出呢?只有 2 個數字:轉向角和加速度。

這意味著神經網路必須從 20 億個輸入 tokens 中,找出正確的因果關係,然後壓縮成 2 個動作。如果隨機挑 2 個位元輸出,那很簡單;但要挑「對」的 2 個動作,系統必須真正理解場景。問題是,神經網路很容易學到假相關(spurious correlations)。例如,每次煞車時樹枝剛好在晃動,模型可能誤以為「樹枝晃動」是煞車的原因。正確的因果關係應該是「前車亮煞車燈」或「前車打方向燈」,但這在統計上不一定比樹枝晃動更顯著。

解決方法是數據,大量的、多樣的、涵蓋各種邊緣案例的數據。Tesla 在這方面有獨特優勢:他們的車隊規模巨大,每天可以產生相當於 500 年的駕駛數據。當然,大部分數據是無聊的高速公路直行,沒有訓練價值。關鍵是識別「有趣」的數據,例如校車出現、消防車穿越、其他車輛打滑失控。Tesla 在車上部署了觸發器,當特定事件發生時自動上傳數據,這樣就能從「無聊數據的海洋」中撈出稀有但重要的樣本。

Ashok 播放了一段車禍影片:前車突然打滑撞上護欄,而 Tesla 的 FSD 在車禍發生前數秒就開始減速。他指出,系統在前車「偏移角速度異常」的瞬間就判斷出情況不對,遠早於車禍實際發生。這種預判能力,需要從大量真實車禍案例中學習,不是工程師能手寫規則定義的。

評估:最困難的問題

Ashok 說,在三大挑戰中,評估(Evaluation)是最難的。

自駕是長尾問題(long-tail problem),99% 的場景可能都處理得很好,但那 1% 的邊緣案例決定了系統能不能上路。傳統的評估方法是路測,但要覆蓋所有邊緣案例,需要的里程數是天文數字。而且很多危險場景無法重現,你不能為了測試而故意製造車禍。

Tesla 的解法是訓練一個「世界模擬器」(World Simulator)神經網路。這個模型的任務是:給定當前的影片和控制動作,預測下一幀影片會長什麼樣子。訓練數據就是車輛行駛過程中收集的影片和對應的動作,把因果關係反過來就變成了世界模型。

有了世界模擬器,你可以把它和自駕策略網路串在一起,形成閉環:策略網路輸出動作,世界模擬器根據動作生成下一幀,策略網路再根據新的一幀輸出下一個動作。這樣就可以在純虛擬環境中測試自駕系統,不需要實際上路。

Ashok 展示的 demo 相當驚人:世界模擬器可以生成 8 顆攝影機、36 fps、5 百萬畫素解析度的影片,持續一分鐘以上,而且所有畫素都是生成的,沒有任何真實影像。更重要的是,你可以用它來「回放」歷史問題。假設某個版本的 FSD 在特定場景表現不好,你可以用世界模擬器重建那個場景,然後測試新版本的模型是否改善了。你甚至可以「注入」原本沒發生的對抗場景,例如把一段直行影片改成有行人突然衝出來,測試系統的反應。

世界模擬器還可以跑在即時模式。Ashok 展示了用遊戲控制器操控虛擬車輛在生成的世界中行駛,所有畫面都是神經網路即時生成的。這基本上是用 AI 做了一個無限細節的駕駛模擬器。

從車到 Optimus:通用機器人基礎模型

Ashok 強調,他們建構的不只是「自駕神經網路」,而是「機器人基礎模型」(Foundational Model for Robotics)。同一套架構、同一個訓練流程,可以用在汽車,也可以用在人形機器人 Optimus。

他展示了世界模擬器泛化到室內場景的例子:Optimus 在室內行走,模擬器可以根據動作指令(直走、左轉、右轉)生成對應的第一人稱視角影片。同樣的模型也可以處理機械臂操作,例如打開抽屜、撿起物品。

這呼應了 Bitter Lesson 的另一個面向:通用方法比專用方法更有價值。與其為汽車設計一套系統、為機器人設計另一套系統,不如建構一個足夠通用的模型,讓它從數據中學會不同任務。Tesla 的策略是用同一套訓練基礎設施、同一套數據收集框架,同時推進自駕車和人形機器人。

Ashok 說,Cybercab 會在今年(2026 年)推出,這是一款沒有方向盤和踏板的車,完全為自動駕駛設計。同時,Optimus 也會進入量產。他認為這兩個產品會大幅降低交通和體力勞動的成本,為世界創造「驚人的富足」(amazing abundance)。

為什麼只用攝影機?

在 Q&A 環節,有人問了一個很多人心中的疑問:為什麼 Tesla 這麼堅持只用攝影機?其他公司用 LiDAR、雷達、高精地圖,難道不是更安全嗎?

Ashok 的回答很直接:「你今天怎麼來這裡的?」

現場笑了。他繼續說:「很多人是自己開車來的,用的是眼睛。你可以用眼睛走進這棟建築、在裡面走動。用攝影機解決這個問題,對我來說是顯而易見的。」

他的論點是:自駕的核心問題是 AI 不夠聰明,感測器早就夠用了。攝影機已經提供了足夠的資訊,問題是能不能從中提取出正確的理解。2008 年 DARPA 挑戰賽時代,AI 技術還不成熟,所以需要 LiDAR 這種「直接給你距離資訊」的感測器作為拐杖。但現在是 2026 年,AI 已經強大到可以從 2D 影像中推斷 3D 結構、預測其他道路使用者的意圖。

這也是 Bitter Lesson 的延伸:不要依賴捷徑。LiDAR 是一種捷徑,它繞過了「從影像理解 3D」的難題。但如果你相信 AI 終將解決這個難題,那麼依賴捷徑只會讓你的系統更複雜、更貴、更難規模化。Tesla 選擇直接攻克難題,賭的就是 AI 能力的持續進步。

規模的勝利

Tesla 在奧斯汀的 Robotaxi 服務已經對公眾開放,車內沒有安全員。根據 Ashok 展示的數據,使用 FSD 的車輛每次碰撞之間的行駛里程數,是手動駕駛的至少 2 倍。這個數據來自數十億英里的實際行駛統計,不只是高速公路,也包括城市道路。

這是不是代表自駕問題已經解決?當然不是。Ashok 自己也說,還有很多技術挑戰,招人中。但從方法論的角度看,Tesla 的故事是 Bitter Lesson 的一次成功驗證:放棄手工規則,押注端到端神經網路、海量數據、大規模運算。這個賭注,至少到目前為止,似乎押對了。

更有趣的是,這套方法不只適用於自駕車,也適用於人形機器人、機械臂、任何需要在真實世界中行動的 AI 系統。Tesla 正在建構的,不只是一家汽車公司或機器人公司,而是一個通用機器人 AI 的基礎設施。

回到開頭那群過馬路的雞。如果你是傳統派,你會開始設計雞腿偵測器、鳥類行為預測模組、動物優先權規則。如果你相信 Bitter Lesson,你會收集一百萬段有雞的影片,然後讓神經網路自己學。Tesla 選了後者。

相關資料

Ashok Elluswamy(Tesla AI 副總裁)演講:Building Foundational Models for Robotics at Tesla

2026 ScaledML Conference, presented by Matroid

https://www.youtube.com/watch?v=LFh9GAzHg1c

Richard Sutton, The Bitter Lesson (2019)

http://www.incompleteideas.net/IncIdeas/BitterLesson.html